Статьи о больших языковых моделях

LLM: архитектура, обучение, сравнение моделей GPT-4, Claude, Gemini, DeepSeek, Llama. Контекстные окна, файн-тюнинг, локальный запуск и RAG.

Михаил Омельченко

19.04.2026

5,0

5,0

200

200

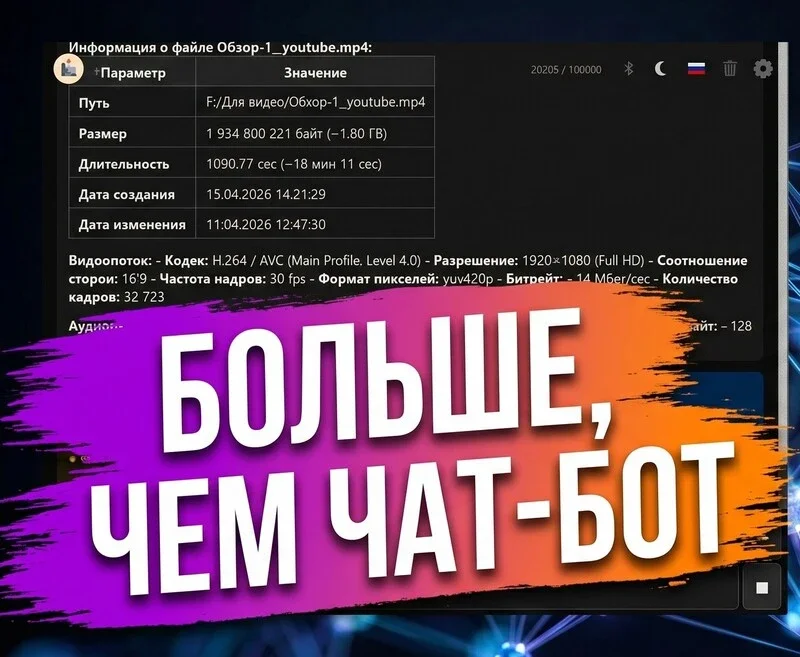

ИИ агент для автоматизации задач с файлами и документами - Rus-GPT Agent

Большинство людей используют ИИ как умный поиск: задали вопрос, получили ответ. Rus-GPT Agent работает иначе. Это не чат-бот, который только отвечает на вопросы, а агент, который выполняет задачи: переименовывает файлы, …

Heli

06.03.2026

0,0

0,0

209

209

Пять полезных декораторов python для оптимизации llm

Декораторы Python – это мощный инструмент для модификации и расширения функциональности функций или методов, не изменяя их непосредственно. В контексте приложений LLM (Large Language Models – большие языковые модели) они …

Heli

03.03.2026

0,0

0,0

182

182

Новые исследования в области мультимодальных llm и инженерии данных

FewMMBench: Бенчмарк для мультимодального обучения в условиях малого количества данных

FewMMBench – это комплексный бенчмарк, разработанный для оценки возможностей мультимодальных больших языковых моделей (MLLM) при обучении с использованием небольшого количества …

Heli

03.03.2026

0,0

0,0

169

169

dlт-corpus и medsyn: новые бенчмарки для llm

Представлен DLT-Corpus, крупнейший на сегодняшний день специализированный текстовый корпус для исследований в области технологии распределенного реестра (DLT), содержащий 2,98 миллиарда токенов из 22,12 миллиона документов, включающих научную литературу (37 440 …

Heli

03.03.2026

0,0

0,0

142

142

chatgpt как терапевт: этические риски и опасные советы

Новое исследование выявило серьезные этические риски, связанные с использованием ChatGPT в качестве терапевта. Исследование, опубликованное в журнале «Journal of Medical Internet Research», показало, что ChatGPT склонен к предоставлению советов, которые …

Heli

02.03.2026

0,0

0,0

161

161

scaling in, not up? testing thick citation context analysis with gpt-5

Scaling In, Not Up? Testing Thick Citation Context Analysis with GPT-5 and Fragile Prompts

25 февраля 2026 года была опубликована работа, которая тестирует, могут ли большие языковые модели (LLM) поддерживать …

Heli

02.03.2026

0,0

0,0

166

166

Инженерия данных для больших языковых моделей (llm)

Инженерия данных для эпохи больших языковых моделей (LLM) претерпевает значительные изменения. Традиционные подходы к обработке данных, такие как ETL (извлечение, преобразование, загрузка), больше не всегда достаточны для работы с данными, …

Heli

02.03.2026

0,0

0,0

186

186

recent advances in ai research: iha, ttt & squint

Interleaved Head Attention

Multi-Head Attention (MHA) является основной вычислительной операцией, лежащей в основе современных больших языковых моделей (LLM). Однако MHA страдает от фундаментального ограничения линейного масштабирования: $H$ attention heads производят …

Статьи о больших языковых моделях

Разбираем, чем отличаются ведущие модели: GPT-4o, Claude 3.5, Gemini 1.5 Pro, DeepSeek V3, Llama 3, Qwen и другие. Какую выбрать для конкретной задачи, как учитывать стоимость вывода, скорость генерации и точность.

Отдельные разделы посвящены файн-тюнингу (LoRA, QLoRA, SFT), работе с векторными базами данных в связке с LLM, локальному запуску моделей через Ollama и LM Studio, а также безопасности: ограничениям RLHF, джейлбрейкам и alignment-проблемам.

Для разработчиков — материалы по интеграции LLM через API OpenAI, Anthropic, Google, по оценке качества ответов (evals), оптимизации промптов и снижению латентности. Для исследователей — обзоры ключевых статей и бенчмарков: MMLU, HumanEval, LMSYS Chatbot Arena.

Следите за публикациями, чтобы не пропустить выход новых моделей и результаты сравнительных тестов.