Heli

23.01.2026

0,0

0,0

108

108

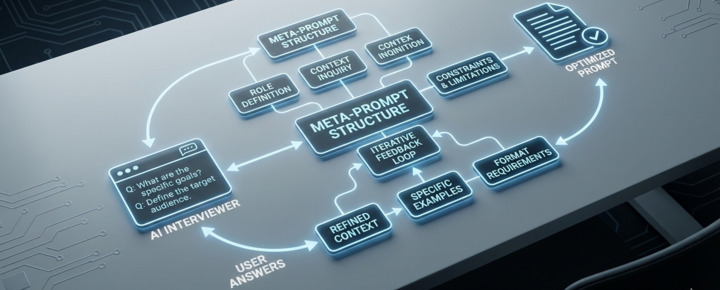

Как создать идеальный промпт через диалог с нейросетью

Давайте создадим помощника, который будет сам улучшать ваши промпты. Вместо того чтобы мучительно подбирать формулировки, мы заставим нейросеть задавать уточняющие вопросы. Покажу на примерах, как это работает.

Что такое мета-промпт

…

SwampEjik

26.12.2025

0,0

0,0

138

138

Как заставить ChatGPT писать как человек, а не как нейросеть

Почему тексты ChatGPT сразу узнаются? Проблема не в том, что нейросеть “плохо пишет”. Проблема в том, как именно она привыкла писать по умолчанию.

Если дать ChatGPT абстрактную задачу вроде “напиши …

Heli

28.08.2025

0,0

0,0

3007

3007

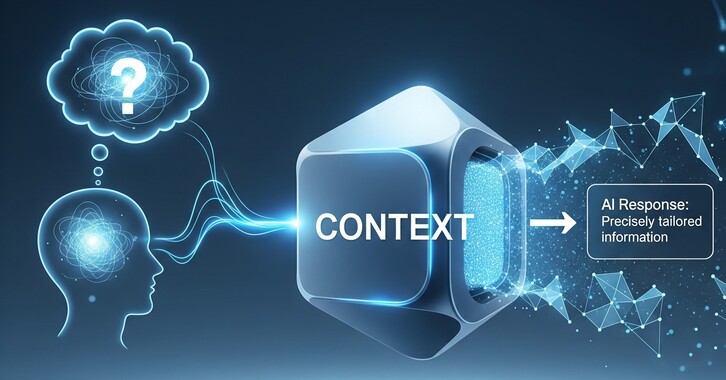

Раздел "контекст" в промпте нужен, чтобы

В мире искусственного интеллекта (ИИ) и генеративных моделей, таких как GPT, Claude, Qwen и другие, качество ответа напрямую зависит от того, насколько точно пользователь сформулировал задачу. Ключевым элементом эффективного промпта …

Mikhail

28.08.2025

0,0

0,0

220

220

Self-Consistency – Самосогласованность: как повысить точность ответов LLM

В современном мире искусственного интеллекта, где большие языковые модели (LLM) всё чаще используются для генерации текста и решения сложных задач, качество и надёжность их ответов становятся критически важными. Однако даже …

Heli

27.08.2025

0,0

0,0

213

213

Chain-of-Thought: логика через пошаговые объяснения

Chain-of-Thought (CoT) — техника prompt-инжиниринга, при которой модель не просто выдает ответ, а показывает промежуточные шаги рассуждения. Это повышает точность на сложных задачах и делает выводы прозрачными и проверяемыми.

Почему …

Mikhail

27.08.2025

0,0

0,0

176

176

Рассуждение (Reasoning) в больших языковых моделях (LLM): теория и практика

Большие языковые модели уже умеют писать и отвечать. Чтобы они были надёжнее в математике, коде и аналитике, их нужно побуждать к пошаговому рассуждению — тогда виден не только ответ, но …

Mikhail

24.08.2025

5,0

5,0

192

192

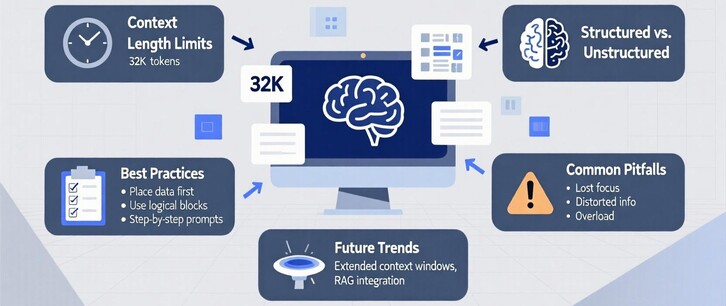

Работа с контекстом в длинных промптах: теория, практика и рекомендации

Почему контекст важен в промптах

В LLM контекст играет ключевую роль в обеспечении точности и полезности ответов. Однако длинные промпты могут вызывать сложности: модели могут терять фокус, искажать информацию …

Mikhail

21.08.2025

0,0

0,0

231

231

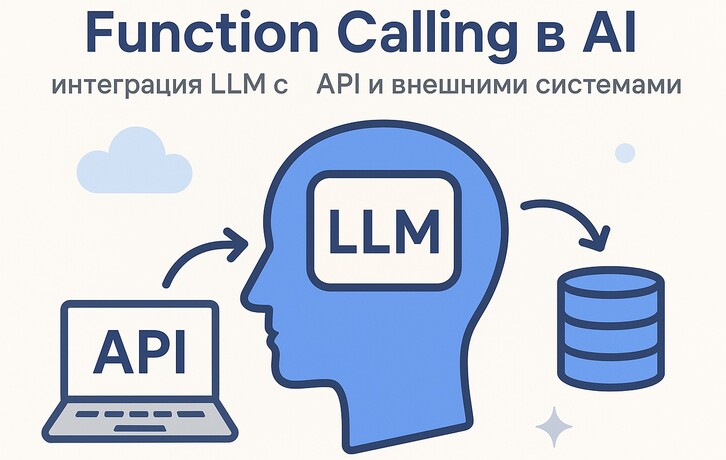

Function Calling в AI: Как LLM взаимодействуют с внешними инструментами

Function Calling — это ключевой механизм, позволяющий искусственному интеллекту (AI) взаимодействовать с внешними системами, инструментами и базами данных. В эпоху, где большие языковые модели (LLM) становятся основными помощниками в бизнесе, …

Статьи о промпт-инжинирингу

Основные темы: chain-of-thought (пошаговые рассуждения), few-shot prompting (примеры в запросе), role prompting (ролевые инструкции), системные промпты и структурирование вывода. Разбираем, почему одни формулировки работают лучше других и как это использовать на практике.

Отдельные материалы посвящены специфике разных моделей: как Claude реагирует на XML-теги, почему GPT-4o лучше следует примерам, как настраивать DeepSeek для технических задач.

Для разработчиков — промпты для генерации кода, code review, написания тестов и документации. Для менеджеров и маркетологов — шаблоны для анализа данных, составления отчётов и создания контента. Для исследователей — техники self-consistency, ReAct и Tree of Thought.

Все примеры проверены на реальных задачах и снабжены объяснением, почему выбрана именно такая структура запроса.